深度赋能:慧诺联合科研团队提出基于单目深度信息的近似无监督作物分割方法

发布时间:

2025-03-21

来源:

作者:

自2012年深度卷积神经网络(CNN)问世以来,植物表型分析与人工智能便紧密相连。基于计算机视觉和深度学习的图像分割,是众多植物表型图像分析任务的起点。随着植物表型研究的重心逐渐向大田环境转移,对大田作物图像分割的挑战愈发严峻。光线、阴影、杂草等诸多因素,都可能影响分割精度。为此,通常需要大量的像素级人工数据标注工作,而这些工作往往占据了分割模型开发工作量的80%~90%。俗话说,“人工智能是先有人工后有智能”,我们常常关注到的是“智能”部分,却容易忽视“人工”环节所耗费的巨大精力。

2025年3月21日,《Plant Phenomics》在线发表了一篇由慧诺瑞德公司韩志国博士、华中科技大学陆昊博士和中国科学院遗传与发育生物学研究所胡伟娟博士等共同完成的研究论文——《The Blessing of Depth Anything: An Almost Unsupervised Approach to Crop Segmentation with Depth-Informed Pseudo Labeling》。论文提出一种名为DepthCropSeg的算法,利用Depth Anything V2 (DAM) 这一视觉基础模型生成的深度图,构建高质量的伪掩码,实现了接近全监督水平的几乎无监督作物分割。

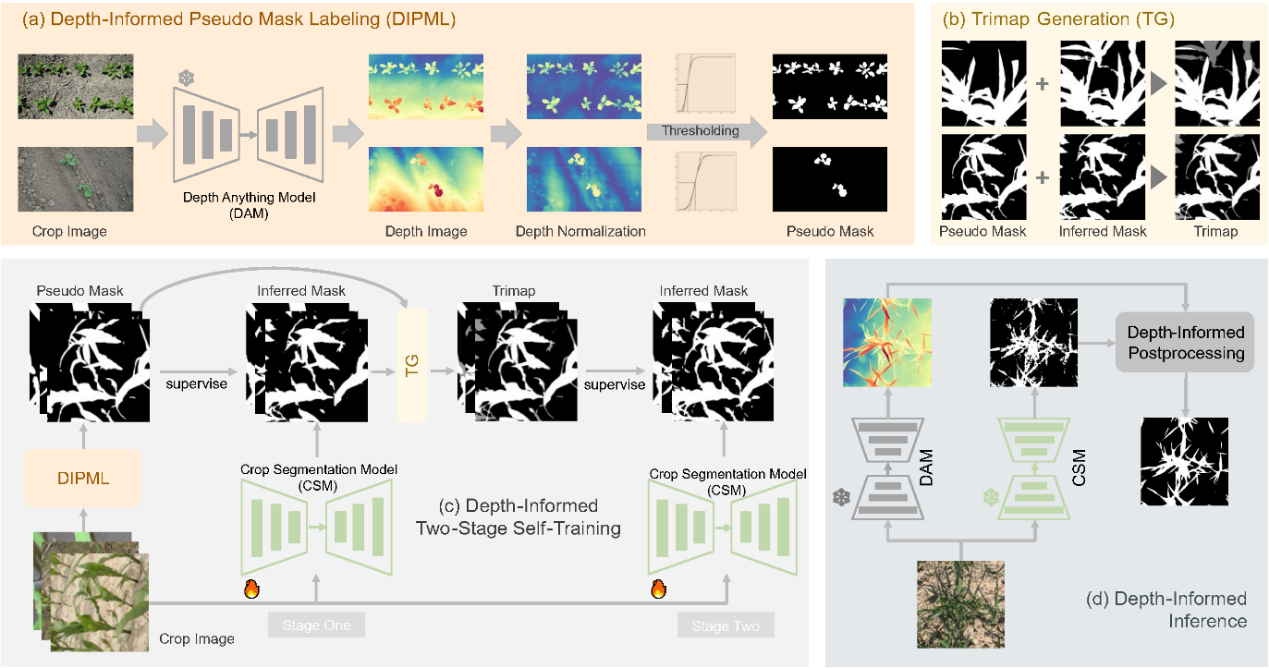

图1 DepthCropSeg算法的技术流程图

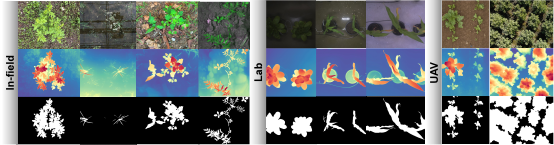

本研究整合了田间、实验室和无人机等10个公开数据集,这些数据集提供了可用的真值掩码,便于进行定量验证。DepthCropSeg的技术流程如图1所示。该方法首先通过归一化和梯度引导的直方图阈值分割技术,从DAM模型生成的深度图中获取初始伪掩码。然而,部分伪掩码质量较低,无法直接用于训练。因此,该方法提出了一种由粗到精的人工筛选流程,以剔除存在明显错误的伪掩码。与传统的像素级人工标注相比,该方法能够极其高效地获得准确的作物伪掩码(图2),这也是本论文“近似无监督”理念的核心所在。

图2 Depth Anything V2模型在多种场景下提取高质量伪标签

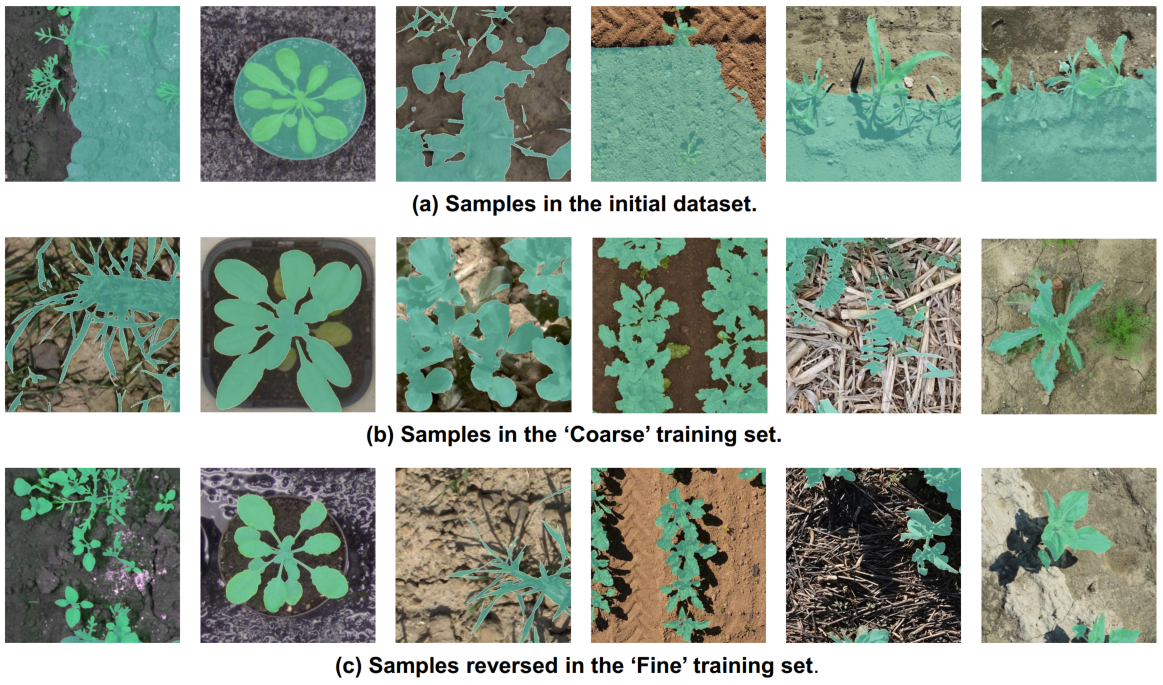

由粗到精的人工筛选流程如图3所示。在粗略筛选阶段,将伪掩码的伪彩图叠加在RGB图像上,通过缩略图快速筛查出标注明显错误的区域(例如,背景被误标为作物)。仅耗时2小时,便从17199张原始图像中筛选出3577张较为准确的伪掩码数据集。在精细筛选阶段,进一步剔除标注存在细小错误的图像,通过逐一查看每张图像,排除有一半以上绿色植物未被标注的错误掩码。经过约4小时的精细筛选后,最终得到1378张高质量的训练数据集。整个筛选流程耗时约6小时,显著提高了训练数据标注效率,相比传统像素级手工标注方法,可节省约两个月的时间。考虑到伪掩码仍不可避免地会引入少量标注噪声,本研究还设计了基于深度信息的两阶段自监督训练策略,并引入深度引导的双边滤波技术,以提高分割图预测的鲁棒性。

图3 由粗到细的人工筛选流程

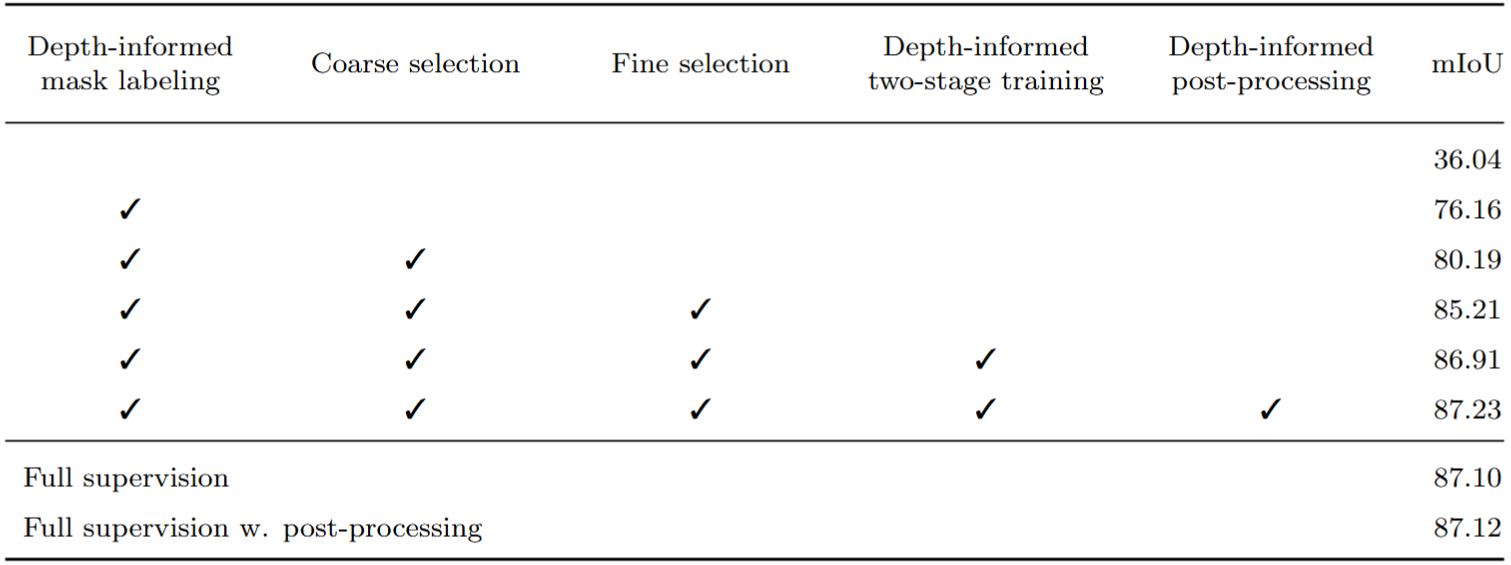

表1 DepthCropSeg消融实验结果

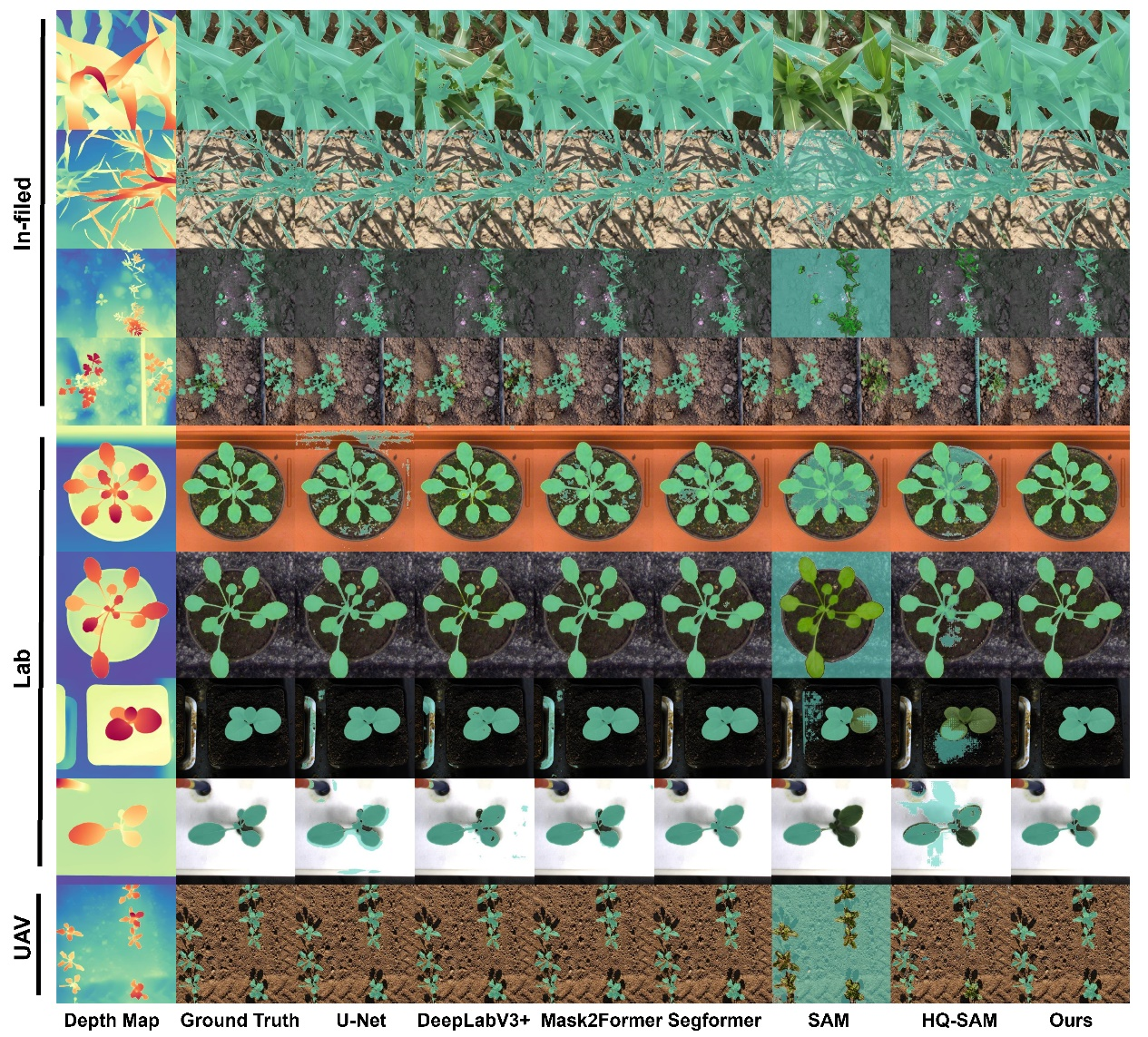

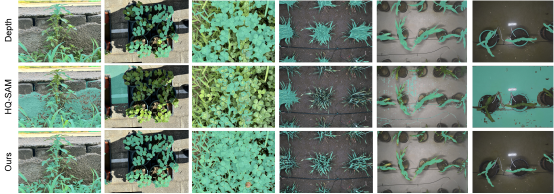

为了验证技术流程中各种策略的有效性,通过消融实验(表1)表明,经过本方法四阶段处理后的分割结果可以媲美使用手工标注数据训练的全监督模型。通过可视化对比全监督训练和DepthCropSeg训练的分割结果,可以看出:不论是在田间、实验室和无人机的多种场景下(图3),还是在轨道式高通量植物表型平台TraitDiscover或手机采集的图像上(图4和图5),DepthCropSeg均实现了接近全监督性能的作物分割效果。

图4 全监督和近似无监督分割方法的可视化结果对比

图5 在轨道式高通量表型平台TraitDiscover和手机拍摄的图片上的分割效果可视化

慧诺瑞德公司创始人韩志国博士表示,“2024年6月份,香港大学和字节跳动联合发表了Depth Anything V2论文预印本,我们于7月初便关注到,并开始在作物分割上进行尝试。7月14日我们得到的初步结果非常令人振奋,于是迅速成立攻关小组,进行算法攻关和文章撰写,并于9月4日向《Plant Phenomics》投稿。目前,该算法已经嵌入到慧诺瑞德各类型植物表型产品的图像分析环节,大大提高了分析效率和鲁棒性。初步估计,该算法可以节省人工数据标注环节70%~80%的工作量。

华中科技大学人工智能与自动化学院陆昊副教授表示:“本研究的主要价值在于展示了单目深度估计在生成高质量作物分割伪掩码方面的巨大潜力,向植物表型研究领域引入了一种近似无监督的作物分割方法。该方法避免了常规作物分割方法中对手工像素级标注的依赖,极大减少了模型开发成本,同时在性能上接近全监督水平,为植物表型研究提供了新的工具和思路。”

中国科学院遗传与发育生物学研究所植物表型组学研究中心胡伟娟博士表示,“我们通过产学研合作的形式,极大缩短了算法从实验室到业务端的周期。我们将DepthCropSeg算法应用到先导项目四个基地的数据分析中,实践证明效果非常好,可显著提高表型图像自动化分析的效率和成功率。”

论文匿名审稿人表示,“This manuscript is suitable for publication, as it offers a novel and efficient solution to a key challenge in segmentation task, which is efficient label creation. The manuscript is clearly written, with high-quality figures and tables, and it references relevant literature. Through robust comparisons against benchmark methods and ablation studies, the study makes a valuable contribution to the field.”

作者介绍

慧诺瑞德公司实习生/华中科技大学人工智能与自动化学院曹松良和徐冰慧为论文共同第一作者;中国科学院遗传与发育生物学研究所胡伟娟博士、慧诺瑞德公司/宏表型实验室/慧诺云谱公司韩志国博士和华中科技大学陆昊博士为论文共同通讯作者;华中科技大学人工智能与自动化学院周炜和周乐天,慧诺瑞德公司宏表型实验室算法工程师张佳菲和张勇帅,一起深度参与了算法开发。本研究得到了中国科学院战略性先导科技专项(XDA24040201)、中央引导地方项目(2024ZY-CGZY-19)、国家自然科学基金/面上项目(32370435)、国家重点研发计划(2023YFF1001502)和长春市市院科技创新合作专项(23SH18)等项目的资助。

推荐新闻

视频展示