学术中心

Yield-SpikeSegNet: SpikeSegNet的产量估算扩展应用

发布时间:

2022-12-06

来源:

植物表型资讯

作者:

PhenoTrait

与计算机视觉相结合的高通量植物表型分析是植物非破坏性和非侵入性育种领域的一个新兴课题。以非破坏性的方法分析小麦植株中大量基因型的新穗和籽粒重或产量的估算,已经引起了广泛的研究关注。

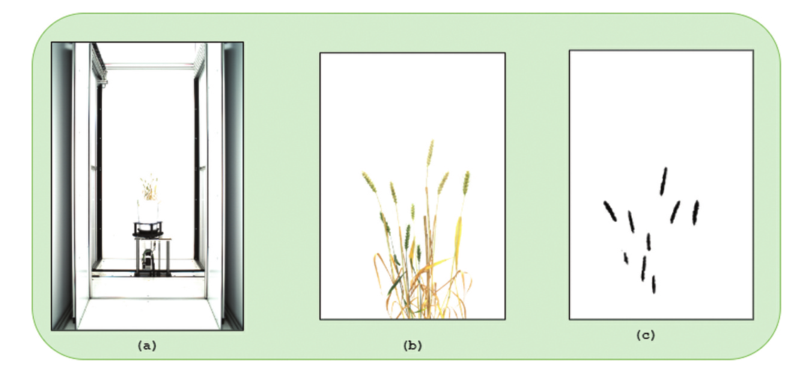

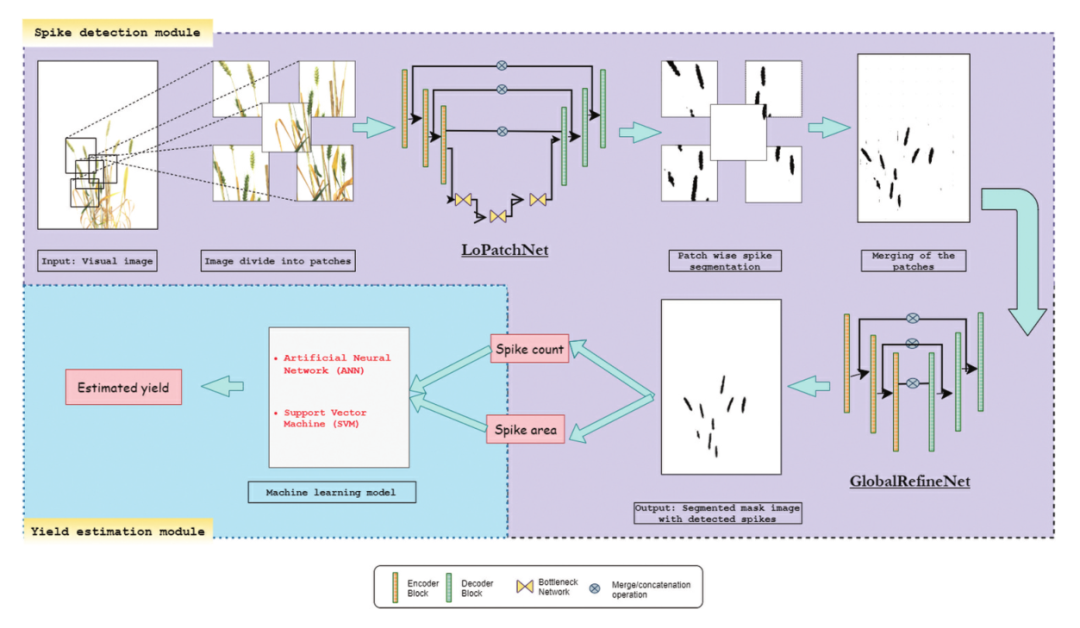

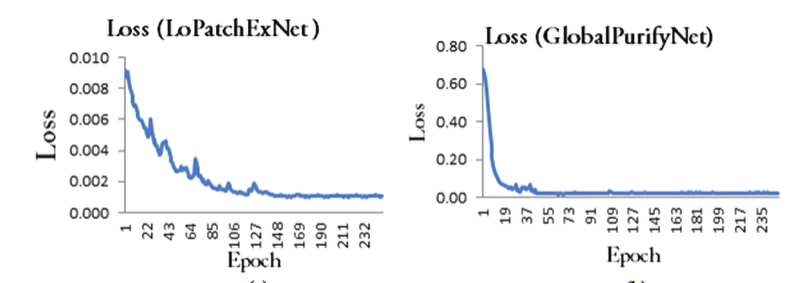

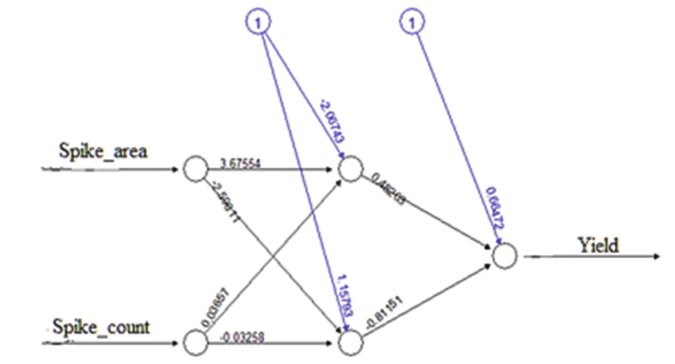

在这项研究中,我们开发了一种深度学习方法,“Yield-SpikeSegNet”,用于利用视觉图像估算小麦植株的产量。采用PROSILICA GT6600 (LemnaTecGmbH, Aachen, Germany)相机,传感器分辨率为6576 × 4384像素,对盆栽中生长的小麦植株进行视觉图像(400 ~ 700 nm)捕获,如图1。Yield-SpikeSegNet由两个连续的模块组成:“麦穗检测模块”和“产量估计模块”,如图2。麦穗检测模块采用深度编码器-解码器网络,该模块由两个基本特征网络依次组成:本地补丁提取网络(Local Patch Extraction Network,LoPatchExNet)和全局净化网络(Global Purifying Network,GlobalPurifyNet),实现麦穗分割,模块输出的是麦穗面积和麦穗计数,训练曲线如图3。在产量估算模块中,我们利用人工神经网络(Artificial neural network,ANN,图4)和支持向量回归建立了用于小麦作物产量估算的机器学习模型。该模型的精度、准确性和鲁棒性分别为0.9982、0.9987和0.9992。穗的分割和产量估计的性能反映了Yield-SpikeSegNet方法是在高通量和无损小麦表型分型领域向前迈出的重要一步。

图1 (a)拍摄的植物图像不仅包括植物部分,还包括室内的其他部分,(b)裁剪图像得到感兴趣的区域(植物部分),(c)与裁剪图像相对应的地真分割掩模图像。

图1 (a)拍摄的植物图像不仅包括植物部分,还包括室内的其他部分,(b)裁剪图像得到感兴趣的区域(植物部分),(c)与裁剪图像相对应的地真分割掩模图像。

图2 由麦穗检测和产量估计模块组成的Yield-SpikeSegNet

图2 由麦穗检测和产量估计模块组成的Yield-SpikeSegNet

图3 (a) LoPatchExNet和(b) GlobalPurifyNet的训练损失

图3 (a) LoPatchExNet和(b) GlobalPurifyNet的训练损失

图4 拟合的ANN模型体系结构

图4 拟合的ANN模型体系结构

来 源

Tanuj Misra, Alka Arora, Sudeep Marwaha, Ranjeet Ranjan Jha, Mrinmoy Ray, Shailendra Kumar, Sudhir Kumar & Viswanathan Chinnusamy (2022) Yield-SpikeSegNet: An Extension of SpikeSegNet Deep-Learning Approach for the Yield Estimation in the Wheat Using Visual Images, Applied Artificial Intelligence, 36:1, 2137642, DOI: 10.1080/08839514.2022.2137642

编 辑

王春颖

扩展阅读

推荐新闻

视频展示